OpenAI o3 и o4-mini умеют находить место по фото

OpenAI o3 и o4-mini: ИИ, который находит локацию по фото

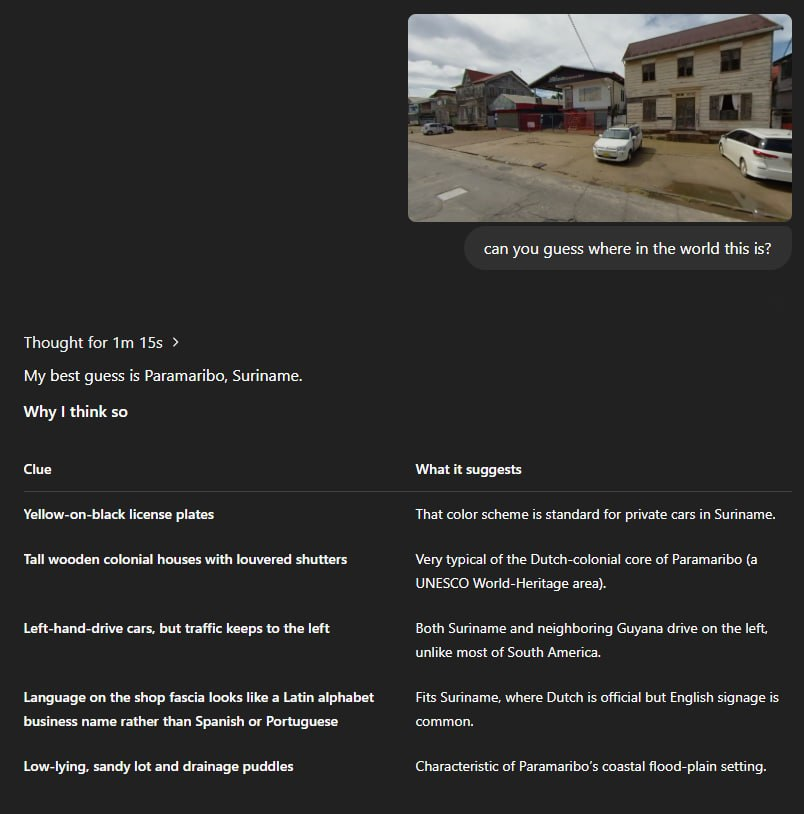

OpenAI представила новые языковые модели — o3 и o4-mini, и они оказались не просто шагом вперёд, а настоящим прорывом. Одной из самых впечатляющих способностей этих нейросетей стала функция, которую раньше могли освоить лишь опытные OSINT-аналитики: определение местоположения по фотографии.

Если раньше такие задачи требовали времени, знаний и инструментов, теперь достаточно одного снимка. Всё остальное — дело искусственного интеллекта.

Что умеют модели?

Модели o3 и o4-mini могут «читать» изображение практически как человек, только быстрее и внимательнее. После загрузки фото нейросеть:

- анализирует каждый пиксель;

- выделяет характерные детали — архитектуру, природные объекты, текстуры, надписи;

- сопоставляет эти данные с базами данных и картами;

- предсказывает локацию с удивительной точностью.

И что особенно ценно — она не просто выдаёт сухой адрес. AI описывает, почему выбрал именно это место: указывает видимые ориентиры, язык вывесок, тип местности и даже погоду на снимке. Это делает ответ не только точным, но и обоснованным.

Как использовать?

Механика проста: загружаете фото и пишете, что хотите узнать, например:

- «Где это место?»

- «Определи страну или город по пейзажу»

- «Что видно на изображении и где это может быть?»

Далее происходит магия: модель «прокручивает» изображение, масштабирует важные зоны, смотрит на здания, текстуру асфальта или растений — и выдаёт анализ.

Причём это работает как с современными фото, так и с архивными или даже изображениями со спутника.

OSINT стал доступен каждому

Эти технологии открывают новую эру в анализе изображений. То, что раньше делали спецслужбы или частные расследователи с помощью сложного софта и команд, теперь доступно любому человеку с доступом к ChatGPT.

💡 Примеры применения:

- журналисты могут проверять подлинность снимков;

- преподаватели — объяснять географические особенности через изображения;

- тревел-блогеры — искать локации по чужим фото;

- просто любопытные — узнавать, где сделан тот загадочный снимок в соцсетях.

Разница между o3 и o4-mini

- o3 — более продвинутая, мощная и точная модель. Подходит для сложных задач, где нужно много логики, детализации и аргументов.

- o4-mini — компактнее, работает быстрее, но всё ещё выдаёт отличные результаты. А главное — бесплатна и доступна даже без подписки ChatGPT Plus.

Для большинства задач, особенно визуального анализа, o4-mini вполне хватает. Она вызывается по кнопке «Thinking» и справляется даже с многослойными фото с низким качеством.

Не только картинки

Важно: обе модели не ограничиваются одной функцией. Они по-прежнему умеют:

- выполнять поиск и анализ данных;

- писать и улучшать код;

- генерировать тексты;

- отвечать на вопросы;

- решать задачи по математике, физике, химии.

Но именно умение думать через изображения — это то, что делает их особенно ценными в 2025 году. Это уже не просто языковые модели, а многофункциональные цифровые ассистенты, способные решать задачи на стыке текста, визуала и логики.

Готовый промт:

Ты профессиональный игрок в Geoguessr, с точностью определяешь любое место на земле. Пойми, где это снято, в полную меру своих возможностей.

Вывод

OpenAI o3 и o4-mini — это не просто обновлённые ИИ. Это инструменты, которые могут изменить подход к анализу информации, сделать OSINT доступным каждому и упростить десятки рутинных задач.

Попробуйте загрузить своё фото и спросить: «Где это?»

Возможно, вы удивитесь, насколько умным может быть ваш цифровой помощник.

Кстати, если интересуетесь визуальными нейросетями, посмотрите обзор бесплатного генератора изображений FluxAI.